Linear Regression

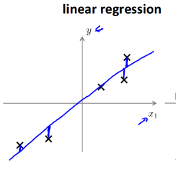

其也叫最小二乘。以2-D的线性回归为例,寻找其垂直方向上的距离和最短,如下图所示

原理

-

Hypothesis

-

Cost Function

使用MSE,其是 convex 的 (TODO其loss其实也是通过likehood推导出来的,见bishop) -

Gradient

- Solve

- 可以用Gradient Descent

- Normal Equation

当加入L2 regularization时,其等式变为

- Miscellaneous

- 其也可以用来分类,如将目标设为1和0.此时的分界面为. 1

References

-

The Elements of Statistical Learning ↩